Das Atelier

Beschreibung

metaSpace ist ein adaptives, lernfähiges System das mit dem Nutzer agiert und auf ihn reagiert. Durch audio-visuelle Eindrücke die im gesamten Raum auftreten können, wird die Raumwahrnehmung des Nutzers in dem Maße manipuliert wie es die Situation Bedarf. Dabei geht das System komplett auf die Bedürfnisse des Nutzers ein und lernt den Nutzer und seine Emotionen / Launen zu interpretieren.

Das Produkt als solches funktioniert jedoch nur in der Utopie: das im Semesterprojekt entwickelte Konzept umfasst einen Prototypen der zu experimentellen Zwecken genutzt wird. Die Technik ist in diesem Prototypen im gesamten Raum verteilt, also kein Objekt welches fest installiert und als Produkt im ganzen gekauft werden kann.

Geht man nun davon aus, dass Produkte in Zukunft nicht mehr an die aktuellen Grenzen des technisch Möglichen gebunden sind, und unser System die gesamte Technik in einem klar definierten und vermarktbaren Objekt vereinen können, dann wäre dies das Marktreife Produkt.

Designphilosophie

Der Anspruch in der Gestaltung von metaSpace war, so individuell wie nur möglich auf die Nutzungskontexte der User einzugehen. Dafür wurden Personas, Usecases und User Stories erarbeitet. Jedoch führt diese Herangehensweise dazu, dass vordefinierte Abläufe in der Interaktion gestaltet werden, die dann unter Umständen im alltäglichen Gebrauch nicht mehr funktionieren, weil der Nutzungskontext des Users sich über die Zeit verändert hat. Daraus folgt, dass AmI Systeme eine deutlich längere Haltbarkeit vorweisen müssen als z.B. Smartphones und Tablets. Der Grund dafür ist, dass die Installation und die Erneuerung dieser Systeme deutlich aufwendiger ist, als die von mobilen Computern. Dieser Umstand führt zu einer Paradigmenverschiebung in der Gestaltung von Interaktion.

Während die Designphilosophie der Schule des Bauhauses “Form Follows Function” prägend im Arbeitsprozess der Gestaltung war, muss diese in Folge der Paradigmenverschiebung in “Form is Function” abgeändert werden. Die Idee ist, dass ein Produkt nicht mehr vorbestimmte Funktionen bekommt und dementsprechend geformt wird, sondern dass in der Gestaltung des Produktes ein Mechanismus entworfen wird, der die Funktionen des Produktes dem jeweiligen Nutzer entsprechend generiert. Ein System oder Produkt, das in der Lage ist seinen Funktionsumfang eigenständig zu verändern ist dadurch auch in der Lage seine Form im übertragenen Sinne zu verändern. Für die Gestaltung bedeutet das, dass die Konzeption der Intelligenz des Systems eine deutlich größere Rolle einnimmt, als es vorher der Fall war.

Die Intelligenz

metaSpace basiert auf einem Computersystem, das über verschiedene Arten von Sensorik, Ereignisse in der physikalischen Welt aufnimmt und in digitale Werte wandelt, um sie anschließend zu interpretieren.

Als Basis für die Verarbeitung sind die von der Sensorik wahrgenommenen Werte in zwei Kategorien unterteilt, die in Kombination den Gesamtkontext bilden. Dies ist zum einen das Befinden des Nutzers und zum anderen der aktuelle Nutzungskontext in dem sich der Nutzer befindet.

Als Basis für das Nutzerbefinden soll der Emotionserkennungs-Algorithmus “Shore”, entwickelt vom Fraunhofer Institut, genutzt werden. Dieser kann anhand von Kamerabildern Emotionen sowie Geschlecht und Alter erkennen, zudem geht das Konzept von einer Nutzung von Biodaten wie Puls und Körpertemperatur aus, die über externe Geräte ermittelt werden, und in Kombination mit den über “Shore” gewonnen Daten genauere Rückschlüsse auf das Befinden des Nutzers geben können.

Der Nutzungskontext wird aus der momentanen Uhrzeit, der Position des Nutzers im Raum, der Körperhaltung des Nutzers und den Gegenständen mit denen der Nutzer interagiert gebildet. Hierfür wird Sensorik im Raum genutzt um die entsprechenden Daten zu sammeln.

Um metaSpace eine größtmögliche Flexibilität und eine möglichst große Individualität für unterschiedliche Nutzergruppen zu ermöglichen, enthält metaSpace keine vordefinierten Nutzungskontexte, da diese, abhängig vom Nutzer, komplett unterschiedlich sein können.

Das System ist darauf ausgelegt, Nutzungskontexte anhand von sensorisch aufgenommenen Daten selbständig zu kreieren. Da die Sensordaten durch das System vergleichbar sind, können diese in Relation gesetzt und abweichende Nutzungskontexte automatisiert erstellt werden. Des Weiteren unterscheidet der Algorithmus keine expliziten Nutzer, sondern erkennt anhand der Kontextanalyse in welchem Kontext sich ein Nutzer befindet und entscheidet somit welcher audio-visueller Output generiert wird. Sobald der Algorithmus durch die Anwesenheit eines Nutzers gestartet wird, werden die Sensordaten für das Befinden des Nutzers und die des Nutzungskontextes erfasst.

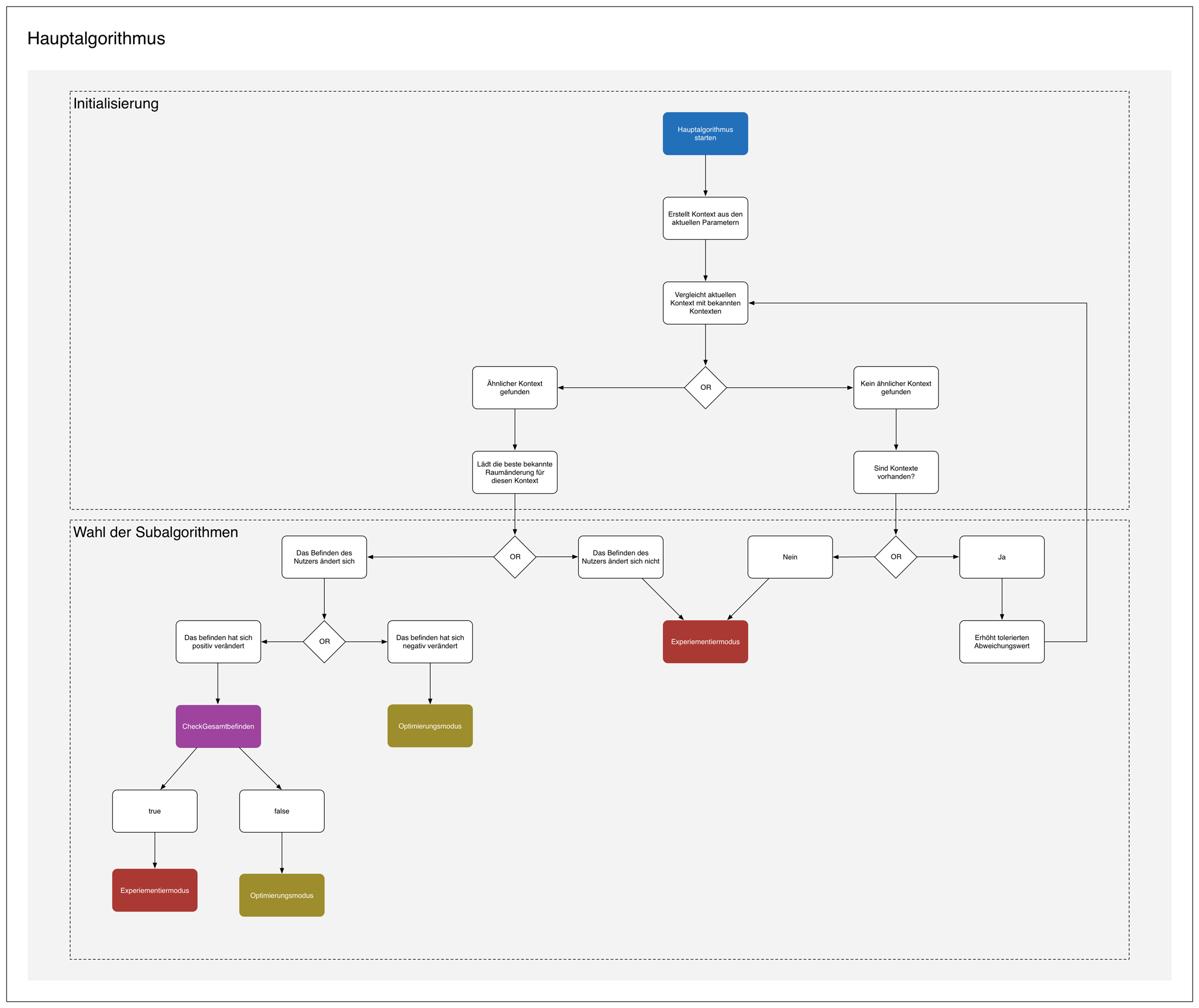

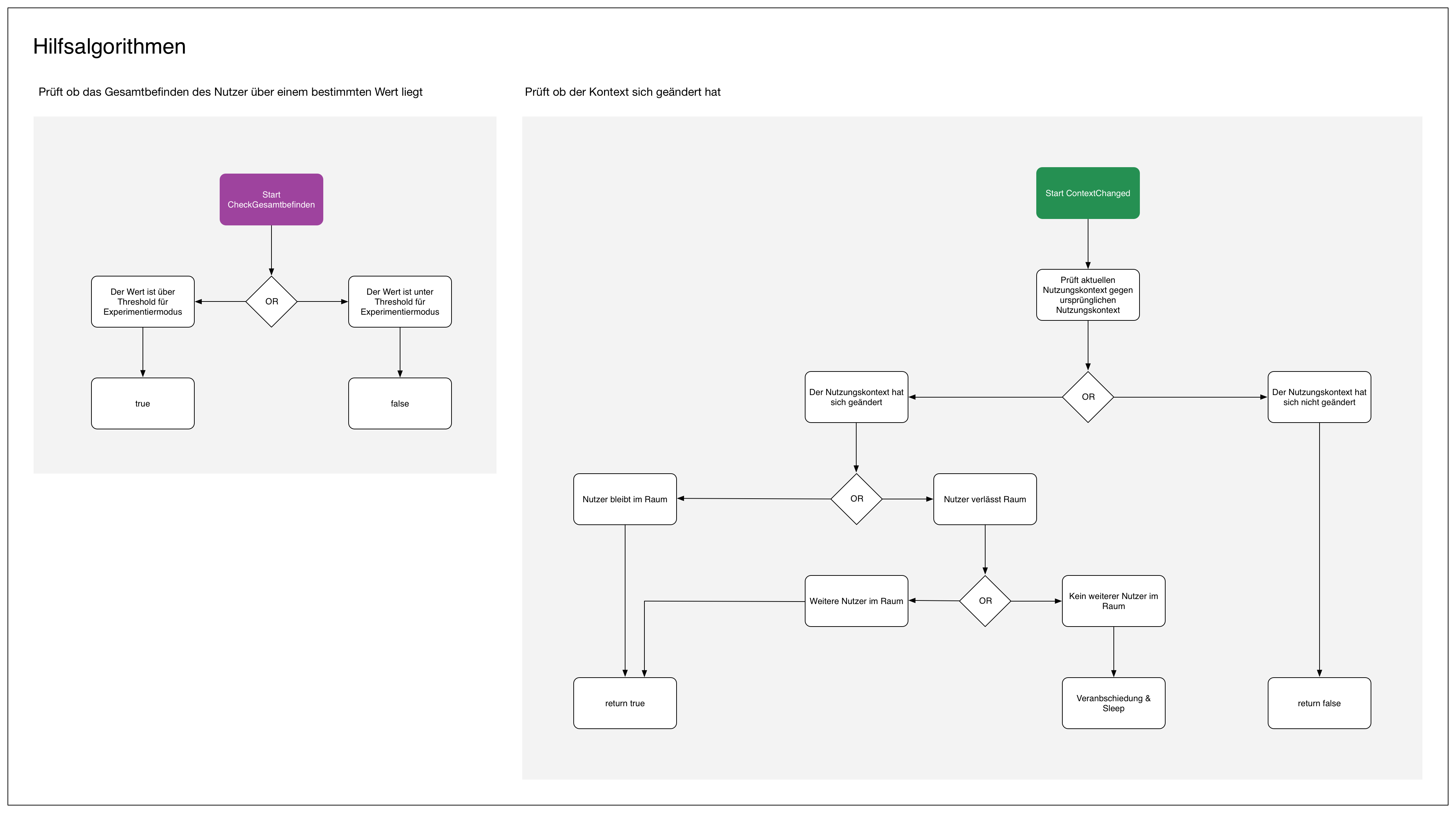

Der Algorithmus erörtert zunächst das Befinden und den Nutzungskontext und vergleicht den aktuellen mit bekannten Nutzungskontexten. Wenn kein ähnlicher gefunden werden kann, erhöht der Algorithmus den Schwellwert für die Parameter der Nutzung. Dies geschieht so lange bis ein vergleichbarer Nutzungskontext gefunden werden konnte. Falls noch keiner bekannt ist oder kein ähnlicher Nutzungskontext gefunden werden kann, startet das System den ersten möglichen Subalgorithmus.

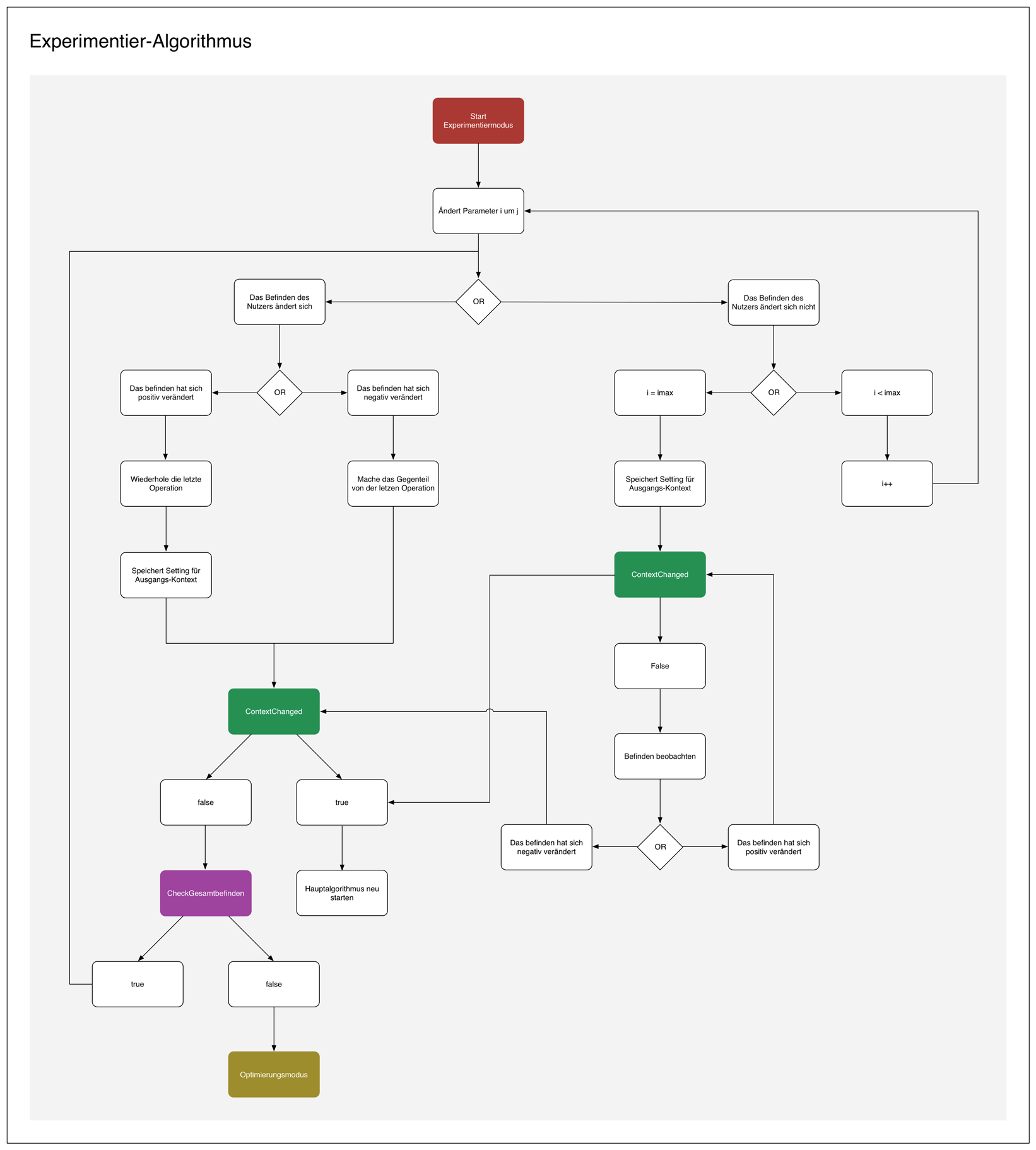

Dieser Subalgorithmus (Experimentiermodus) evaluiert das Befinden des Nutzer und verändert die Parameter der Ausgabe und beobachtet die Befindensänderung um den Nutzer besser kennen zu lernen. Der Algorithmus ändert hierbei Schritt für Schritt die unterschiedlichen Ausprägungen des Outputs. Wenn sich das Befinden positiv verändert, wird die Änderung erneut ausgeführt. Für den Fall, dass die Änderung das Befinden des Nutzers negativ verändert hat, führt das System eine Änderung des Parameters in die entgegengesetzte Richtung durch. Wenn sich das Befinden des Nutzers durch die Änderung der Ausprägung eines Outputs nicht ändert, lädt der Algorithmus die nächste Art von Output und führt die selben Schritte aus, wie bei dem ersten Parameter. Anschließend werden die Parameter aus den verschiedenen Bereichen (z.B. auditiv, visuell etc.) mit den signifikantesten Änderungen miteinander kombiniert und die kombinierte Wirkung auf den Nutzer wird erörtert. Dies geschieht entsprechend nacheinander mit absteigender Priorisierung, je geringer die Befindensänderung für den einzelnen Parameter vom System erkannt werden konnte.

Der Experimentiermodus wird nur gestartet, wenn das System keine (vergleichbaren) Kontexte kennt, oder wenn das Gesamtbefinden des Nutzers über einem hohen Schwellwert ist.

Diese beiden Fälle stellen zwei Stufen von Freundschaft dar, welche dem Anwendungscharakter des Systems entsprechen. Zum einen muss in einer Freundschaft zunächst eine Beziehung aufgebaut werden, dies entspricht dem Fall, wenn das System den Nutzer kennenlernen muss und auf Grund dessen in den Experimentiermodus geht. Der zweite Fall entspricht dem Verhalten des “Grenzen austesten” in einer freundschaftlichen Beziehung. Wenn das System den Nutzer bereits kennt, und weiß, dass der Nutzer sich in einer guten emotionalen Verfassung befindet, kann das System seine Grenzen austesten, so wie es unter Freunden ebenso üblich ist.

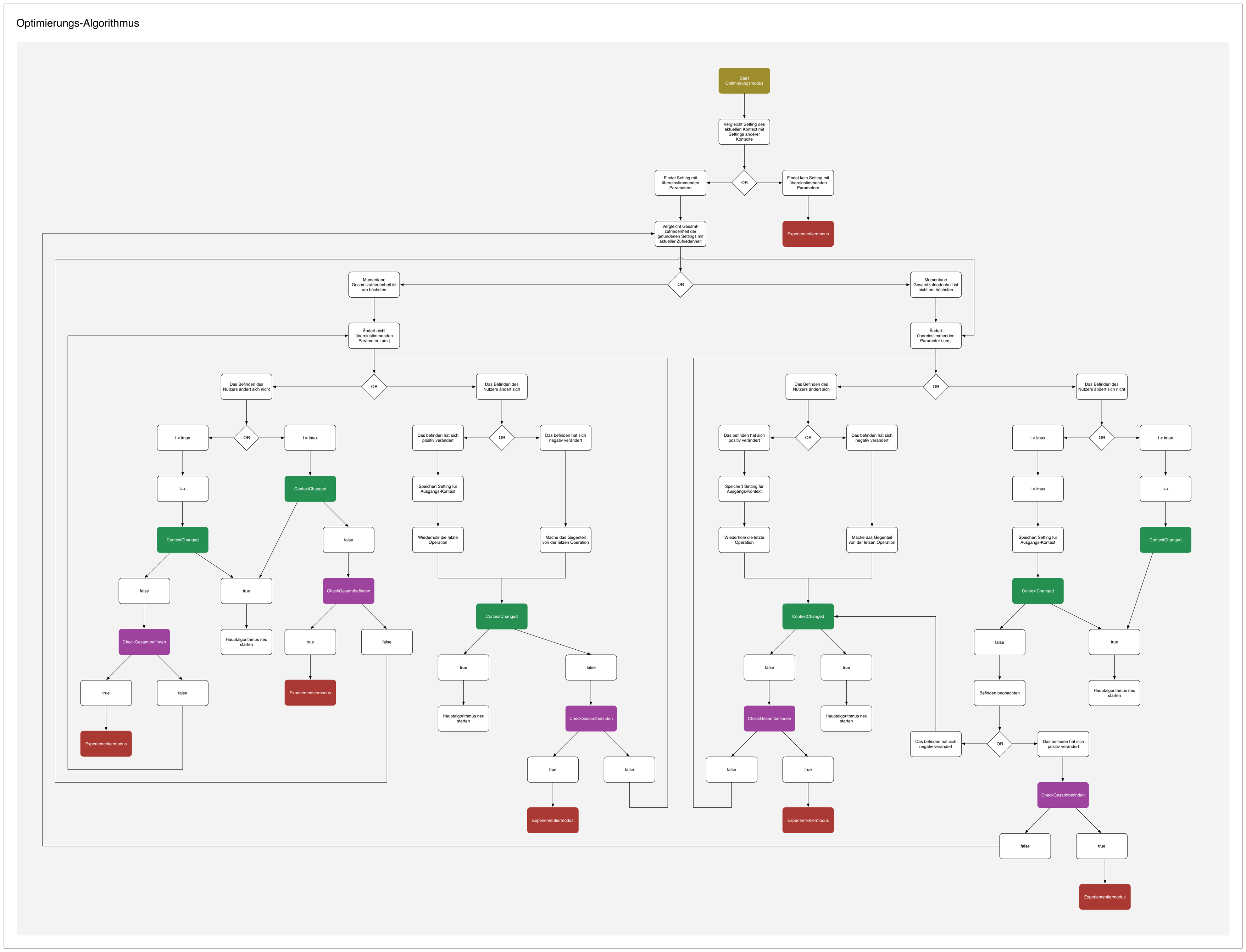

Der zweite Subalgorithmus ist der Optimierungsmodus. Dieser wird ausgeführt, wenn das System einen Nutzungskontext kennt, das Befinden des Nutzers jedoch unter dem im Experimentiermodus angesprochenen Schwellwert ist. Das System versucht hierbei das Befinden des Nutzers zu verbessern, indem es Mechanismen anwendet, von denen das System gelernt hat, dass sie in ähnlichen Kontexten das Befinden verbessert haben. Das System ruft hierbei ähnliche Kontexte ab und testet ob eine Änderung von bestimmten Parametern eine Änderung des Befindens hervorrufen können. Eine andere Option in diesem Modus ist, dass das System versucht, das Befinden des Nutzers so zu steigern, dass der Schwellwert um in den Experimentiermodus zu wechseln überschritten wird.

Im Bezug auf den Anwendungscharakter ist dieser Modus wiederum eine Analogie zu einem Freund, der versucht einen aufzumuntern, wenn das Befinden in der momentanen Situation nicht durchweg positiv ist.

Interaktionsdesign

metaSpace und der Nutzer im Raum interagieren permanent miteinander. Für metaSpace ist jede Geste, jede Bewegung, jede Interaktion mit einer Person oder einem Gegenstand ein Kontext für den metaSpace nach passenden Raumdarstellungen sucht. Die Interaktion findet dadurch im alltäglichen Gebrauch passiv statt, da ein klassisches Interface in metaSpace keine Anwendung findet. Dafür steht der Raum selbst und sein Inhalt als Interface zur Verfügung. Der Mensch interagiert direkt und gewohnt mit seiner Umgebung und dadurch entsteht im selben Moment eine indirekte Interaktion mit dem System. Durch die Natürlichkeit der Interaktion mit dem Raum entsteht eine hohe Qualität dieser Interaktion, da der Nutzer sich in seiner Umgebung natürlich verhält und dadurch das System manipuliert.

metaSpace benötigt kein Setup oder Anmelden seitens des Nutzers. Es Identifiziert ihn durch sein Verhalten und das Muster, das sich in seinem Tagesablauf zeigt. Dadurch kann metaSpace die gesammelten Daten, die auch sehr persönliche und private Informationen beinhalten können anonymisiert speichern. So wird der Wert der Daten geschwächt und potenzieller Missbrauch vermieden.

In diesem System können Metaphern, Synecdochen und Metonomien entstehen, ganz abhängig von dem Verhältnis das sich zwischen User und System gebildet hat. Interaktionsmuster entstehen und verändern sich. Dadurch, dass das System dynamisch ist, sind die rhetorischen Stilmittel nicht vorhersehbar. Als Beispiel könnte das Anzünden einer Kerze sich als Metapher für Wärme und Nähe etablieren.

Um diese freie Dynamik zu gewährleisten und eine konsequente Benutzererfahrung zu schaffen hält sich metaSpace an ein Interaktionskodex, die durch die Intelligenz gewährleistet wird:

- Bevormunde nicht den Nutzer.

- Sei unauffällig und stehle nicht die Aufmerksamkeit des Nutzers.

- Lerne den Nutzer kennen und entwickle dich mit ihm/ihr weiter.

- Koste den User keine Zeit.

- Sei für deinen User da, wenn er dich braucht.

Ausblick

metaSpace bietet nicht nur unendliche Möglichkeiten in Hinblick auf Raum, es gibt durch die Menge an gesammelten Informationen auch unendliche Möglichkeiten in Hinblick auf personalisiertem Content. Dafür müssen lediglich die Effekte durch Content ersetzt werden und die Parameter des Contents in das System übertragen werden. Content könnte z.B. ein Mail Postfach sein und die Parameter, Absender und Anzahl. metaSpace würde dann mit der Zeit testen in welchen Kontexten Mails vom User abgerufen werden und herausfinden, wann es angebracht ist Mails von bestimmten Personen anzuzeigen. Da es mit der Zeit die persönlichen Vorzüge, Bedürfnisse und Interessen lernt, kann metaSpace zum Informationshub zwischen der vernetzen Welt und dem User werden. Der große Vorteil ist, dass die Flut an Informationen gefiltert werden kann, ohne dass der Nutzer Zeit dafür aufwenden muss. Zum Beispiel könnte metaSpace eigenständig einen Medieninhalt, wie eine Folge einer Serie oder einen Film einspielen, ohne das der User aktiv interagieren muss. Dadurch können Symbiosen und Synergien entstehen, die sich in personalisierten Gewohnheiten wiederspiegeln. Wie ein eingespieltes Team könnte der User und das System den Alltag bestreiten.

Nächste Wohnung